10.8.- Prueba de Falta de Ajuste

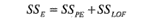

En la sección 6-6 se indicó cómo agregar puntos centrales a un diseño factorial 2k le permite al experimentador obtener una estimación del error experimental puro. Esto permite hacer la partición de la suma de cuadrados de los residuales SSE en dos componentes; es decir,

donde SSPE es la suma de cuadrados debida al error puro y SSLOF es la suma de cuadrados debida a la falta de ajuste.

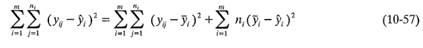

Puede presentarse un desarrollo general de esta partición en el contexto de un modelo de regresión. Suponga que se tienen ni observaciones de la respuesta en el nivel i-ésimo de los regresores xi, i = 1, 2, ..., m. Sea que yij denota la observación j-ésima de1a respuesta en xi, i = 1, 2, ..., m y j = 1, 2, ..., ni. Hay n = ∑mi=1 ni observaciones en total. El residual (ij)-ésimo puede escribirse como

donde y'i es el promedio de las ni observaciones en xi. Al elevar al cuadrado ambos miembros de la ecuación 10-56 y hacer la operación suma sobre i y j se obtiene

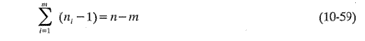

El primer miembro de la ecuación 10-57 es la suma de cuadrados de los residuales ordinaria. Los dos componentes del segundo miembro miden el error puro y la falta de ajuste. Se observa que la suma de cuadrados del error puro

se obtiene calculando la suma de cuadrados corregida de las observaciones repetidas en cada nivel de x y haciendo después la agrupación en los m niveles de x. Si se satisface el supuesto de la varianza constante, ésta es una medida independiente del modelo del error puro, ya que para calcular SSPE sólo se usa la variabilidad de las y en cada nivel xi. Puesto que hay ni - 1 grados de libertad del error puro en cada nivel xi, el número total de grados de libertad asociados con la suma de cuadrados del error puro es

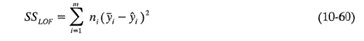

La suma de cuadrados de la falta de ajuste

es una suma ponderada de los cuadrados de las desviaciones entre la respuesta media yi en cada nivel xi, y el valor ajustado correspondiente. Si los valores ajustados yi están cerca de las respuestas promedio yi correspondientes, entonces hay un fuerte indicio de que la función de regresión es lineal. Si las yi se desvían mucho de las yi, entonces es probable que la función de regresión no sea lineal. Hay m - p grados de libertad asociados con SSLOF porque hay m niveles de x, y se pierden p grados de libertad porque deben estimarse p parámetros para el modelo. En lo que a los cálculos se refiere, por lo general SSLOF se obtiene restando SSPE de SSE.

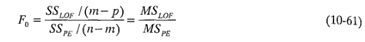

El estadístico de prueba para la falta de ajuste es

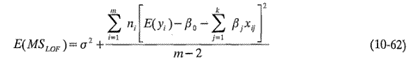

El valor esperado de MSPE es σ2, y el valor esperado de MSLOF es

Si la verdadera función de regresión es lineal, entonces E(yi)=β0+∑kj=1βjxij, y el segundo término de la ecuación 10-62 es cero, dando como resultado E(MSLOF) = σ2. Sin embargo, si la verdadera función de regresión no es lineal, entonces E(yi)≠β0+∑kj=1βjxij y E(MSLOF)>σ2. Además, si la verdadera función de regresión es lineal, entonces el estadístico F0 sigue la distribución Fm-p,n-m. Por lo tanto, para probarla falta de ajuste, se calcularía el estadístico de prueba F0 y se concluiría que la función de regresión no es linealsi F0 > Fa, m-p,n-m.

Es sencillo incorporar este procedimiento de prueba en el análisis de varianza. Si se concluye que la función de regresión no es lineal, entonces el modelo tentativo habrá de abandonarse y deberán hacerse intentos para encontrar una ecuación más apropiada. De manera alternativa, si F0 no excede Fa, m-p,n-m, no existe evidencia sólida de falta de ajuste y MSPE y MSLOF se combinan con frecuencia para estimar σ2. El ejemplo 6-6 es una ilustración muy completa de este procedimiento, donde las réplicas de las corridas son puntos centrales de un diseño factorial 22.